diff --git a/FinancialRiskControl/Task1 赛题理解.md b/FinancialRiskControl/Task1 赛题理解.md

new file mode 100644

index 0000000..dc29dfc

--- /dev/null

+++ b/FinancialRiskControl/Task1 赛题理解.md

@@ -0,0 +1,494 @@

+## Task1 赛题理解

+

+Tip:本次新人赛是Datawhale与天池联合发起的0基础入门系列赛事第四场 —— 零基础入门金融风控之贷款违约预测挑战赛。

+

+赛题以金融风控中的个人信贷为背景,要求选手根据贷款申请人的数据信息预测其是否有违约的可能,以此判断是否通过此项贷款,这是一个典型的分类问题。通过这道赛题来引导大家了解金融风控中的一些业务背景,解决实际问题,帮助竞赛新人进行自我练习、自我提高。

+

+地址:

+

+### 1.1 学习目标

+理解赛题数据和目标,清楚评分体系。

+

+完成相应报名,下载数据和结果提交打卡(可提交示例结果),熟悉比赛流程

+

+

+### 1.2 了解赛题

+- 赛题概况

+- 数据概况

+- 预测指标

+- 分析赛题

+

+### 1.2.1 赛题概况

+

+##### 比赛要求参赛选手根据给定的数据集,建立模型,预测金融风险。

+赛题以预测金融风险为任务,数据集报名后可见并可下载,该数据来自某信贷平台的贷款记录,总数据量超过120w,包含47列变量信息,其中15列为匿名变量。为了保证比赛的公平性,将会从中抽取80万条作为训练集,20万条作为测试集A,20万条作为测试集B,同时会对employmentTitle、purpose、postCode和title等信息进行脱敏。

+

+

+通过这道赛题来引导大家走进金融风控数据竞赛的世界,主要针对于于竞赛新人进行自我练习、自我提高。

+

+### 1.2.2 数据概况

+

+一般而言,对于数据在比赛界面都有对应的数据概况介绍(匿名特征除外),说明列的性质特征。了解列的性质会有助于我们对于数据的理解和后续分析。 Tip:匿名特征,就是未告知数据列所属的性质的特征列。

+

+train.csv

+

+- id 为贷款清单分配的唯一信用证标识

+- loanAmnt 贷款金额

+- term 贷款期限(year)

+- interestRate 贷款利率

+- installment 分期付款金额

+- grade 贷款等级

+- subGrade 贷款等级之子级

+- employmentTitle 就业职称

+- employmentLength 就业年限(年)

+- homeOwnership 借款人在登记时提供的房屋所有权状况

+- annualIncome 年收入

+- verificationStatus 验证状态

+- issueDate 贷款发放的月份

+- purpose 借款人在贷款申请时的贷款用途类别

+- postCode 借款人在贷款申请中提供的邮政编码的前3位数字

+- regionCode 地区编码

+- dti 债务收入比

+- delinquency_2years 借款人过去2年信用档案中逾期30天以上的违约事件数

+- ficoRangeLow 借款人在贷款发放时的fico所属的下限范围

+- ficoRangeHigh 借款人在贷款发放时的fico所属的上限范围

+- openAcc 借款人信用档案中未结信用额度的数量

+- pubRec 贬损公共记录的数量

+- pubRecBankruptcies 公开记录清除的数量

+- revolBal 信贷周转余额合计

+- revolUtil 循环额度利用率,或借款人使用的相对于所有可用循环信贷的信贷金额

+- totalAcc 借款人信用档案中当前的信用额度总数

+- initialListStatus 贷款的初始列表状态

+- applicationType 表明贷款是个人申请还是与两个共同借款人的联合申请

+- earliesCreditLine 借款人最早报告的信用额度开立的月份

+- title 借款人提供的贷款名称

+- policyCode 公开可用的策略_代码=1新产品不公开可用的策略_代码=2

+- n系列匿名特征 匿名特征n0-n14,为一些贷款人行为计数特征的处理

+

+

+### 1.2.3 预测指标

+

+竞赛采用AUC作为评价指标。AUC(Area Under Curve)被定义为 ROC曲线 下与坐标轴围成的面积。

+

+##### 分类算法常见的评估指标如下:

+

+1、混淆矩阵(Confuse Matrix)

+- (1)若一个实例是正类,并且被预测为正类,即为真正类TP(True Positive )

+- (2)若一个实例是正类,但是被预测为负类,即为假负类FN(False Negative )

+- (3)若一个实例是负类,但是被预测为正类,即为假正类FP(False Positive )

+- (4)若一个实例是负类,并且被预测为负类,即为真负类TN(True Negative )

+

+2、准确率(Accuracy)

+准确率是常用的一个评价指标,但是不适合样本不均衡的情况。

+$$Accuracy = \frac{TP + TN}{TP + TN + FP + FN}$$

+

+3、精确率(Precision)

+又称查准率,正确预测为正样本(TP)占预测为正样本(TP+FP)的百分比。

+$$Precision = \frac{TP}{TP + FP}$$

+

+4、召回率(Recall)

+又称为查全率,正确预测为正样本(TP)占正样本(TP+FN)的百分比。

+$$Recall = \frac{TP}{TP + FN}$$

+

+5、F1 Score

+精确率和召回率是相互影响的,精确率升高则召回率下降,召回率升高则精确率下降,如果需要兼顾二者,就需要精确率、召回率的结合F1 Score。

+$$F1-Score = \frac{2}{\frac{1}{Precision} + \frac{1}{Recall}}$$

+

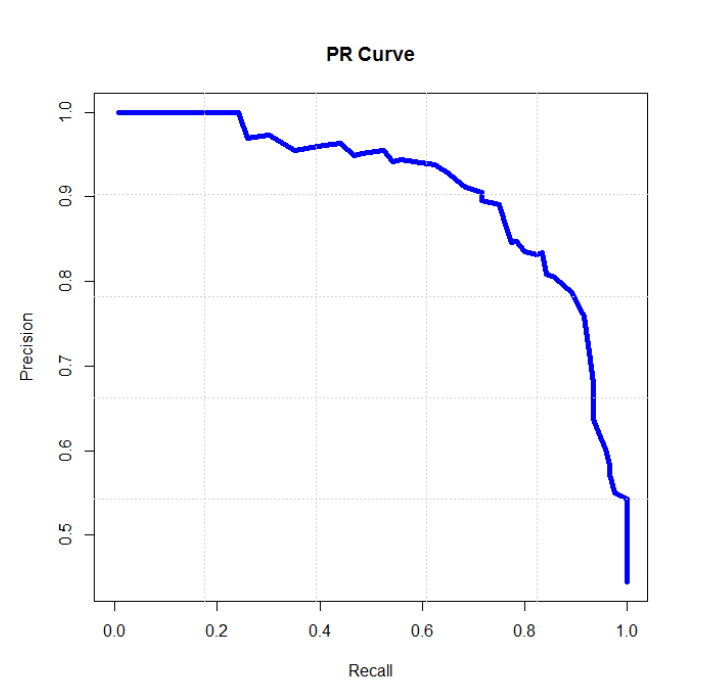

+6、P-R曲线(Precision-Recall Curve)

+P-R曲线是描述精确率和召回率变化的曲线

+

+

+

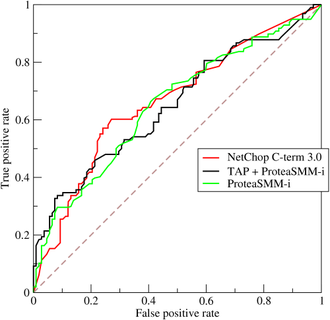

+7、ROC(Receiver Operating Characteristic)

+- ROC空间将假正例率(FPR)定义为 X 轴,真正例率(TPR)定义为 Y 轴。

+

+TPR:在所有实际为正例的样本中,被正确地判断为正例之比率。

+$$TPR = \frac{TP}{TP + FN}$$

+FPR:在所有实际为负例的样本中,被错误地判断为正例之比率。

+$$FPR = \frac{FP}{FP + TN}$$

+

+

+

+8、AUC(Area Under Curve)

+AUC(Area Under Curve)被定义为 ROC曲线 下与坐标轴围成的面积,显然这个面积的数值不会大于1。又由于ROC曲线一般都处于y=x这条直线的上方,所以AUC的取值范围在0.5和1之间。AUC越接近1.0,检测方法真实性越高;等于0.5时,则真实性最低,无应用价值。

+

+

+##### 对于金融风控预测类常见的评估指标如下:

+

+1、KS(Kolmogorov-Smirnov)

+K-S曲线与ROC曲线类似,不同在于

+- ROC曲线将真正例率和假正例率作为横纵轴

+- K-S曲线将真正例率和假正例率都作为纵轴,横轴则由选定的阈值来充当。

+公式如下:

+$$KS=max(TPR-FPR)$$

+KS不同代表的不同情况,一般情况KS值越大,模型的区分能力越强,但是也不是越大模型效果就越好,如果KS过大,模型可能存在异常,所以当KS值过高可能需要检查模型是否过拟合。以下为KS值对应的模型情况,但此对应不是唯一的,只代表大致趋势。

+- KS值<0.2,一般认为模型没有区分能力。

+- KS值[0.2,0.3],模型具有一定区分能力,勉强可以接受

+- KS值[0.3,0.5],模型具有较强的区分能力。

+- KS值大于0.75,往往表示模型有异常。

+2、ROC

+3、AUC

+

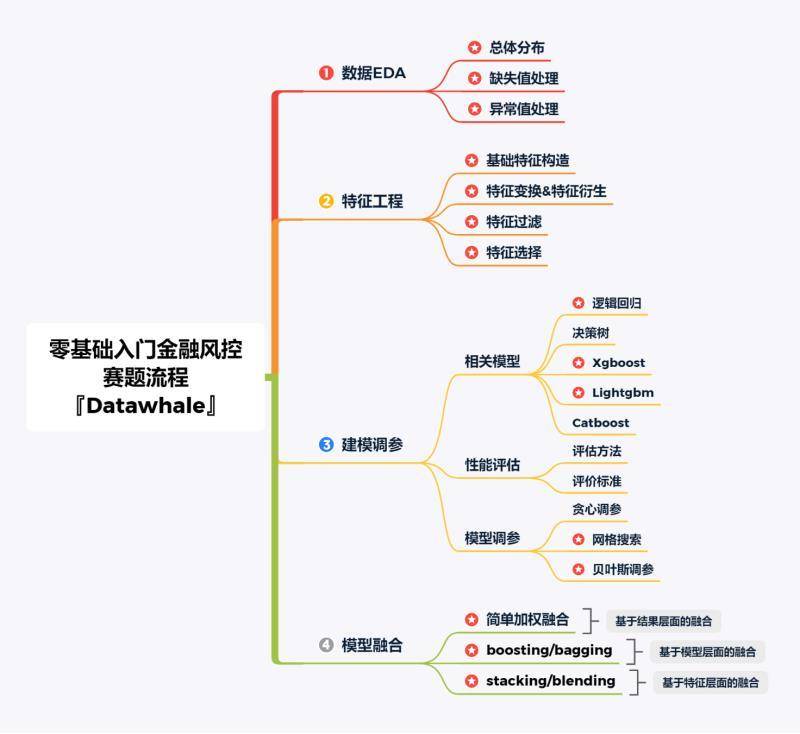

+### 1.2.4. 赛题流程

+

+

+

+### 1.3 代码示例

+

+本部分为对于数据读取和指标评价的示例。

+

+### 1.3.1 数据读取pandas

+

+

+```python

+import pandas as pd

+```

+

+

+```python

+train = pd.read_csv('train.csv')

+testA = pd.read_csv('testA.csv')

+```

+

+

+```python

+print('Train data shape:',train.shape)

+print('TestA data shape:',testA.shape)

+```

+

+ Train data shape: (800000, 47)

+ TestA data shape: (200000, 48)

+

+

+

+```python

+train.head()

+```

+

+

+

+

+

+

+

+

+

+ |

+ id |

+ loanAmnt |

+ term |

+ interestRate |

+ installment |

+ grade |

+ subGrade |

+ employmentTitle |

+ employmentLength |

+ homeOwnership |

+ ... |

+ n5 |

+ n6 |

+ n7 |

+ n8 |

+ n9 |

+ n10 |

+ n11 |

+ n12 |

+ n13 |

+ n14 |

+

+

+

+

+ | 0 |

+ 0 |

+ 35000.0 |

+ 5 |

+ 19.52 |

+ 917.97 |

+ E |

+ E2 |

+ 320.0 |

+ 2 years |

+ 2 |

+ ... |

+ 9.0 |

+ 8.0 |

+ 4.0 |

+ 12.0 |

+ 2.0 |

+ 7.0 |

+ 0.0 |

+ 0.0 |

+ 0.0 |

+ 2.0 |

+

+

+ | 1 |

+ 1 |

+ 18000.0 |

+ 5 |

+ 18.49 |

+ 461.90 |

+ D |

+ D2 |

+ 219843.0 |

+ 5 years |

+ 0 |

+ ... |

+ NaN |

+ NaN |

+ NaN |

+ NaN |

+ NaN |

+ 13.0 |

+ NaN |

+ NaN |

+ NaN |

+ NaN |

+

+

+ | 2 |

+ 2 |

+ 12000.0 |

+ 5 |

+ 16.99 |

+ 298.17 |

+ D |

+ D3 |

+ 31698.0 |

+ 8 years |

+ 0 |

+ ... |

+ 0.0 |

+ 21.0 |

+ 4.0 |

+ 5.0 |

+ 3.0 |

+ 11.0 |

+ 0.0 |

+ 0.0 |

+ 0.0 |

+ 4.0 |

+

+

+ | 3 |

+ 3 |

+ 11000.0 |

+ 3 |

+ 7.26 |

+ 340.96 |

+ A |

+ A4 |

+ 46854.0 |

+ 10+ years |

+ 1 |

+ ... |

+ 16.0 |

+ 4.0 |

+ 7.0 |

+ 21.0 |

+ 6.0 |

+ 9.0 |

+ 0.0 |

+ 0.0 |

+ 0.0 |

+ 1.0 |

+

+

+ | 4 |

+ 4 |

+ 3000.0 |

+ 3 |

+ 12.99 |

+ 101.07 |

+ C |

+ C2 |

+ 54.0 |

+ NaN |

+ 1 |

+ ... |

+ 4.0 |

+ 9.0 |

+ 10.0 |

+ 15.0 |

+ 7.0 |

+ 12.0 |

+ 0.0 |

+ 0.0 |

+ 0.0 |

+ 4.0 |

+

+

+

+

5 rows × 47 columns

+

+

+

+

+

+ |

+ id |

+ loanAmnt |

+ term |

+ interestRate |

+ installment |

+ employmentTitle |

+ homeOwnership |

+ annualIncome |

+ verificationStatus |

+ isDefault |

+ ... |

+ n5 |

+ n6 |

+ n7 |

+ n8 |

+ n9 |

+ n10 |

+ n11 |

+ n12 |

+ n13 |

+ n14 |

+

+

+

+

+ | count |

+ 800000.000000 |

+ 800000.000000 |

+ 800000.000000 |

+ 800000.000000 |

+ 800000.000000 |

+ 799999.000000 |

+ 800000.000000 |

+ 8.000000e+05 |

+ 800000.000000 |

+ 800000.000000 |

+ ... |

+ 759730.000000 |

+ 759730.000000 |

+ 759730.000000 |

+ 759729.000000 |

+ 759730.000000 |

+ 766761.000000 |

+ 730248.000000 |

+ 759730.000000 |

+ 759730.000000 |

+ 759730.000000 |

+

+

+ | mean |

+ 399999.500000 |

+ 14416.818875 |

+ 3.482745 |

+ 13.238391 |

+ 437.947723 |

+ 72005.351714 |

+ 0.614213 |

+ 7.613391e+04 |

+ 1.009683 |

+ 0.199513 |

+ ... |

+ 8.107937 |

+ 8.575994 |

+ 8.282953 |

+ 14.622488 |

+ 5.592345 |

+ 11.643896 |

+ 0.000815 |

+ 0.003384 |

+ 0.089366 |

+ 2.178606 |

+

+

+ | std |

+ 230940.252015 |

+ 8716.086178 |

+ 0.855832 |

+ 4.765757 |

+ 261.460393 |

+ 106585.640204 |

+ 0.675749 |

+ 6.894751e+04 |

+ 0.782716 |

+ 0.399634 |

+ ... |

+ 4.799210 |

+ 7.400536 |

+ 4.561689 |

+ 8.124610 |

+ 3.216184 |

+ 5.484104 |

+ 0.030075 |

+ 0.062041 |

+ 0.509069 |

+ 1.844377 |

+

+

+ | min |

+ 0.000000 |

+ 500.000000 |

+ 3.000000 |

+ 5.310000 |

+ 15.690000 |

+ 0.000000 |

+ 0.000000 |

+ 0.000000e+00 |

+ 0.000000 |

+ 0.000000 |

+ ... |

+ 0.000000 |

+ 0.000000 |

+ 0.000000 |

+ 1.000000 |

+ 0.000000 |

+ 0.000000 |

+ 0.000000 |

+ 0.000000 |

+ 0.000000 |

+ 0.000000 |

+

+

+ | 25% |

+ 199999.750000 |

+ 8000.000000 |

+ 3.000000 |

+ 9.750000 |

+ 248.450000 |

+ 427.000000 |

+ 0.000000 |

+ 4.560000e+04 |

+ 0.000000 |

+ 0.000000 |

+ ... |

+ 5.000000 |

+ 4.000000 |

+ 5.000000 |

+ 9.000000 |

+ 3.000000 |

+ 8.000000 |

+ 0.000000 |

+ 0.000000 |

+ 0.000000 |

+ 1.000000 |

+

+

+ | 50% |

+ 399999.500000 |

+ 12000.000000 |

+ 3.000000 |

+ 12.740000 |

+ 375.135000 |

+ 7755.000000 |

+ 1.000000 |

+ 6.500000e+04 |

+ 1.000000 |

+ 0.000000 |

+ ... |

+ 7.000000 |

+ 7.000000 |

+ 7.000000 |

+ 13.000000 |

+ 5.000000 |

+ 11.000000 |

+ 0.000000 |

+ 0.000000 |

+ 0.000000 |

+ 2.000000 |

+

+

+ | 75% |

+ 599999.250000 |

+ 20000.000000 |

+ 3.000000 |

+ 15.990000 |

+ 580.710000 |

+ 117663.500000 |

+ 1.000000 |

+ 9.000000e+04 |

+ 2.000000 |

+ 0.000000 |

+ ... |

+ 11.000000 |

+ 11.000000 |

+ 10.000000 |

+ 19.000000 |

+ 7.000000 |

+ 14.000000 |

+ 0.000000 |

+ 0.000000 |

+ 0.000000 |

+ 3.000000 |

+

+

+ | max |

+ 799999.000000 |

+ 40000.000000 |

+ 5.000000 |

+ 30.990000 |

+ 1715.420000 |

+ 378351.000000 |

+ 5.000000 |

+ 1.099920e+07 |

+ 2.000000 |

+ 1.000000 |

+ ... |

+ 70.000000 |

+ 132.000000 |

+ 79.000000 |

+ 128.000000 |

+ 45.000000 |

+ 82.000000 |

+ 4.000000 |

+ 4.000000 |

+ 39.000000 |

+ 30.000000 |

+

+

+

+

8 rows × 42 columns

+

+

+

+

+

+ |

+ id |

+ loanAmnt |

+ term |

+ interestRate |

+ installment |

+ grade |

+ subGrade |

+ employmentTitle |

+ employmentLength |

+ homeOwnership |

+ ... |

+ n5 |

+ n6 |

+ n7 |

+ n8 |

+ n9 |

+ n10 |

+ n11 |

+ n12 |

+ n13 |

+ n14 |

+

+

+

+

+ | 0 |

+ 0 |

+ 35000.0 |

+ 5 |

+ 19.52 |

+ 917.97 |

+ E |

+ E2 |

+ 320.0 |

+ 2 years |

+ 2 |

+ ... |

+ 9.0 |

+ 8.0 |

+ 4.0 |

+ 12.0 |

+ 2.0 |

+ 7.0 |

+ 0.0 |

+ 0.0 |

+ 0.0 |

+ 2.0 |

+

+

+ | 1 |

+ 1 |

+ 18000.0 |

+ 5 |

+ 18.49 |

+ 461.90 |

+ D |

+ D2 |

+ 219843.0 |

+ 5 years |

+ 0 |

+ ... |

+ NaN |

+ NaN |

+ NaN |

+ NaN |

+ NaN |

+ 13.0 |

+ NaN |

+ NaN |

+ NaN |

+ NaN |

+

+

+ | 2 |

+ 2 |

+ 12000.0 |

+ 5 |

+ 16.99 |

+ 298.17 |

+ D |

+ D3 |

+ 31698.0 |

+ 8 years |

+ 0 |

+ ... |

+ 0.0 |

+ 21.0 |

+ 4.0 |

+ 5.0 |

+ 3.0 |

+ 11.0 |

+ 0.0 |

+ 0.0 |

+ 0.0 |

+ 4.0 |

+

+

+ | 799997 |

+ 799997 |

+ 6000.0 |

+ 3 |

+ 13.33 |

+ 203.12 |

+ C |

+ C3 |

+ 2582.0 |

+ 10+ years |

+ 1 |

+ ... |

+ 4.0 |

+ 26.0 |

+ 4.0 |

+ 10.0 |

+ 4.0 |

+ 5.0 |

+ 0.0 |

+ 0.0 |

+ 1.0 |

+ 4.0 |

+

+

+ | 799998 |

+ 799998 |

+ 19200.0 |

+ 3 |

+ 6.92 |

+ 592.14 |

+ A |

+ A4 |

+ 151.0 |

+ 10+ years |

+ 0 |

+ ... |

+ 10.0 |

+ 6.0 |

+ 12.0 |

+ 22.0 |

+ 8.0 |

+ 16.0 |

+ 0.0 |

+ 0.0 |

+ 0.0 |

+ 5.0 |

+

+

+ | 799999 |

+ 799999 |

+ 9000.0 |

+ 3 |

+ 11.06 |

+ 294.91 |

+ B |

+ B3 |

+ 13.0 |

+ 5 years |

+ 0 |

+ ... |

+ 3.0 |

+ 4.0 |

+ 4.0 |

+ 8.0 |

+ 3.0 |

+ 7.0 |

+ 0.0 |

+ 0.0 |

+ 0.0 |

+ 2.0 |

+

+

+

+

6 rows × 47 columns

+

+

+

+

+

+ |

+ loanAmnt |

+

+

+ | issueDateDT |

+ 0 |

+ 30 |

+ 61 |

+ 92 |

+ 122 |

+ 153 |

+ 183 |

+ 214 |

+ 245 |

+ 274 |

+ ... |

+ 3926 |

+ 3957 |

+ 3987 |

+ 4018 |

+ 4048 |

+ 4079 |

+ 4110 |

+ 4140 |

+ 4171 |

+ 4201 |

+

+

+ | grade |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+ |

+

+

+

+

+ | A |

+ NaN |

+ 53650.0 |

+ 42000.0 |

+ 19500.0 |

+ 34425.0 |

+ 63950.0 |

+ 43500.0 |

+ 168825.0 |

+ 85600.0 |

+ 101825.0 |

+ ... |

+ 13093850.0 |

+ 11757325.0 |

+ 11945975.0 |

+ 9144000.0 |

+ 7977650.0 |

+ 6888900.0 |

+ 5109800.0 |

+ 3919275.0 |

+ 2694025.0 |

+ 2245625.0 |

+

+

+ | B |

+ NaN |

+ 13000.0 |

+ 24000.0 |

+ 32125.0 |

+ 7025.0 |

+ 95750.0 |

+ 164300.0 |

+ 303175.0 |

+ 434425.0 |

+ 538450.0 |

+ ... |

+ 16863100.0 |

+ 17275175.0 |

+ 16217500.0 |

+ 11431350.0 |

+ 8967750.0 |

+ 7572725.0 |

+ 4884600.0 |

+ 4329400.0 |

+ 3922575.0 |

+ 3257100.0 |

+

+

+ | C |

+ NaN |

+ 68750.0 |

+ 8175.0 |

+ 10000.0 |

+ 61800.0 |

+ 52550.0 |

+ 175375.0 |

+ 151100.0 |

+ 243725.0 |

+ 393150.0 |

+ ... |

+ 17502375.0 |

+ 17471500.0 |

+ 16111225.0 |

+ 11973675.0 |

+ 10184450.0 |

+ 7765000.0 |

+ 5354450.0 |

+ 4552600.0 |

+ 2870050.0 |

+ 2246250.0 |

+

+

+ | D |

+ NaN |

+ NaN |

+ 5500.0 |

+ 2850.0 |

+ 28625.0 |

+ NaN |

+ 167975.0 |

+ 171325.0 |

+ 192900.0 |

+ 269325.0 |

+ ... |

+ 11403075.0 |

+ 10964150.0 |

+ 10747675.0 |

+ 7082050.0 |

+ 7189625.0 |

+ 5195700.0 |

+ 3455175.0 |

+ 3038500.0 |

+ 2452375.0 |

+ 1771750.0 |

+

+

+ | E |

+ 7500.0 |

+ NaN |

+ 10000.0 |

+ NaN |

+ 17975.0 |

+ 1500.0 |

+ 94375.0 |

+ 116450.0 |

+ 42000.0 |

+ 139775.0 |

+ ... |

+ 3983050.0 |

+ 3410125.0 |

+ 3107150.0 |

+ 2341825.0 |

+ 2225675.0 |

+ 1643675.0 |

+ 1091025.0 |

+ 1131625.0 |

+ 883950.0 |

+ 802425.0 |

+

+

+ | F |

+ NaN |

+ NaN |

+ 31250.0 |

+ 2125.0 |

+ NaN |

+ NaN |

+ NaN |

+ 49000.0 |

+ 27000.0 |

+ 43000.0 |

+ ... |

+ 1074175.0 |

+ 868925.0 |

+ 761675.0 |

+ 685325.0 |

+ 665750.0 |

+ 685200.0 |

+ 316700.0 |

+ 315075.0 |

+ 72300.0 |

+ NaN |

+

+

+ | G |

+ NaN |

+ NaN |

+ NaN |

+ NaN |

+ NaN |

+ NaN |

+ NaN |

+ 24625.0 |

+ NaN |

+ NaN |

+ ... |

+ 56100.0 |

+ 243275.0 |

+ 224825.0 |

+ 64050.0 |

+ 198575.0 |

+ 245825.0 |

+ 53125.0 |

+ 23750.0 |

+ 25100.0 |

+ 1000.0 |

+

+

+

+

7 rows × 139 columns

+